在线客服

扫描二维码

下载博学谷APP

扫描二维码

关注博学谷微信公众号

今天本文要讲解的是Hadoop集群动态扩容的内容,那么什么是动态扩容呢?数据量随着公司业务的增长越来越大,原有的datanode节点的容量,已经不能满足存储数据的需求,需要在原有集群基础上,动态添加新的数据节点,这就是我们说的动态扩容。下面一起来看看基础准备、添加datanode、datanode负载均衡服务、添加nodemanager等相关内容吧~

1、基础准备

在基础准备部分,主要是设置 hadoop 运行的系统环境

修改新机器系统 hostname(通过/etc/sysconfig/network 进行修改)

[root@node-4 ~]# cat /etc/sys conf 1g/network

NE TWORKING=yes

HOS TNAME=node -4

[r oot@node-4 ~ ] #

修改 hosts 文件,将集群所有节点 hosts 配置进去(集群所有节点保持hosts文件统一)

rootenode-1 -]# cat /etc/hosts

127.0.0.1 localhost localhost. localdomain localhost4 localhost4. local domain4

: :1 localhost localhost. localdomain localhost6 localhost6. local domain6

192.168.227.151 node-1

192.168.227.152 node-2

192.168.227.153 node-3

192.168.227.154 node-4

rootenode-1 ~]#

设置 NameNode 到 DataNode 的免密码登录(ssh-copy-id 命令实现)

修改主节点 slaves 文件,添加新增节点的 ip 信息(集群重启时配合一键启动脚本使用)

[root@node-1 J]# vim /export/servers/hadoop-2 .6. 0-cdh5.14.0/etc/hadoop/s laves

node-1

node-2

node-3

node-4

在新的机器上上传解压一个新的hadoop安装包,从主节点机器上将hadoop的所有配置文件,scp到新的节点上。

2、添加datanode

在namenode所在的机器的/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop 目录下创建 dfs.hosts 文件

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim dfs.hosts

添加如下主机名称(包含新服役的节点)

node-1

node-2

node-3

node-4

在 namenode 机器的 hdfs-site.xml 配置文件中增加 dfs.hosts 属性

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop vim hdfs-site.xml

<property>

<name>dfs.hosts</name>

<value>/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/dfs.hosts</value>

</property>

dfs.hosts 属性的意义:命名一个文件,其中包含允许连接到namenode的主机列表。必须指定文件的完整路径名。如果该值为空,则允许所有主机。相当于一个白名单,也可以不配置。

在新的机器上单独启动datanode:hadoop-daemon.sh start datanode

[root@node-4 ~]# hadoop-daemon.sh start datanode

starting datanode: logging to /export /servers/hadoop-2.6.0-cdh514 .0/ lops /hadoop root datanode -node-4 out

[root@node-4 ~]#

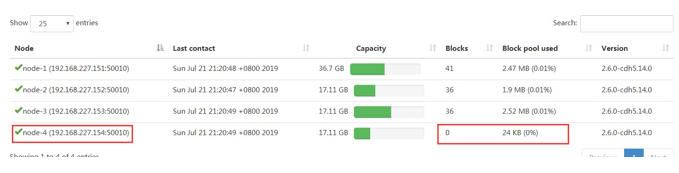

刷新页面就可以看到新的节点加入进来了

3、datanode负载均衡服务

新加入的节点,没有数据块的存储,使得集群整体来看负载还不均衡。因此最后还需要对hdfs负载设置均衡,因为默认的数据传输带宽比较低,可以设置为64M,即hdfs dfsadmin -setBalancerBandwidth 67108864即可

默认balancer的threshold为10%,即各个节点与集群总的存储使用率相差不超过10%,我们可将其设置为5%。然后启动Balancer,sbin/start-balancer.sh -threshold 5,等待集群自均衡完成即可。

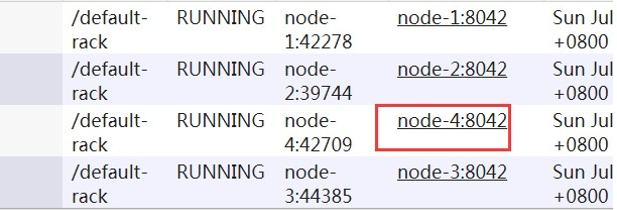

4、添加nodemanager

在新的机器上单独启动 nodemanager:

yarn-daemon.sh start nodemanager

在ResourceManager,通过yarn node -list查看集群情况

以上就是Hadoop集群动态扩容讲解的全部内容,如果你还想更加深入的学习相关内容,可以报名博学谷的大数据课程,在线学习相关视频课程,还有在线讲师一对一为你答疑解惑!

— 申请免费试学名额 —

在职想转行提升,担心学不会?根据个人情况规划学习路线,闯关式自适应学习模式保证学习效果

讲师一对一辅导,在线答疑解惑,指导就业!

相关推荐 更多

如何通过云计算大数据在线培训视频学习项目实战经验?

目前通过参加云计算大数据培训是成为进入大数据行业的重要途径之一。而对于时间并不充裕或者无法脱产学习以及异地学习的朋友而言,更多的选择云计算大数据在线培训的方式学习。那如果通过云计算大数据在线培训视频学习项目实战经验呢?

9515

2019-08-06 19:00:46

学大数据技术必须了解的大数据经典应用案例

我们已经进入了数据化的时代,大数据开发技术、数据分析已经成为目前企业最核心的关注点。数据为企业提供了更加可靠的支撑,对于优化产业结构、提升生产效率有非常明显的作用。在企业纷纷布局大数据业务的同时,大数据相关人才缺口逐渐扩大。目前国内大数据相关从业人员已经超过20万,作为大数据从业人员,必须了解一些大数据相关的经典应用案例。

7915

2019-08-22 18:03:14

大数据分析专家到大数据技术总监如何转型?

大数据分析专家到大数据技术总监如何转型?大数据分析专家偏重对数据分析的能力,而转型成大数据技术总监除了精通数据分析能力还有具备管理能力,可以带团队做项目。

8342

2019-10-24 15:40:08

大数据培训学校哪家好?大数据课程有什么?

大数据培训学校,博学谷实力不错,疫情期间选择博学谷大数据在线学校保证学习效果。提供全方位教学师资团队,提供全方位教学服务,保证学习效果,每个班级都有班主任老师,日常工作管理,老师在线答疑解决学生遇到的问题。

7581

2020-02-25 14:33:20

有程序员我不当,我要当年薪40万的农民工!

不论是在职提升,还是跨专业转型,他们都选择了【狂野大数据】进行学习。国内 IT、通讯、行业招聘中,有 10% 都是和大数据相关的,且比例还在上升。“大数据时代的到来很突然,在国内发展势头激进,而人才却非常有限,现在完全是供不应求的状况。

5963

2021-08-23 16:18:02