在线客服

扫描二维码

下载博学谷APP

扫描二维码

关注博学谷微信公众号

Pandas如何分块处理大文件?在处理快手的用户数据时,碰到600M的txt文本,用sublime打开蹦了,用pandas.read_table()去读竟然花了小2分钟,打开有3千万行数据。仅仅是打开,要处理的话不知得多费劲。

解决:读取文件的函数有两个参数:chunksize、iterator。原理分多次不一次性把文件数据读入内存中。

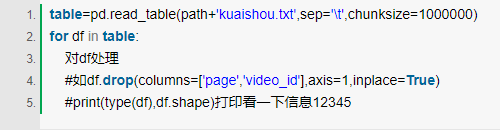

1.指定chunksize分块读取文件

read_csv 和 read_table 有一个 chunksize 参数,用以指定一个块大小(每次读取多少行),返回一个可迭代的 TextFileReader 对象。

对文件进行了划分,分成若干个子文件分别处理(to_csv也同样有chunksize参数)

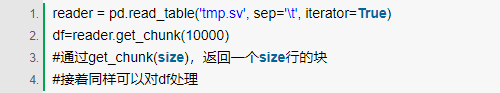

2.指定iterator=True

直接看pandas文档相关的内容。

— 申请免费试学名额 —

在职想转行提升,担心学不会?根据个人情况规划学习路线,闯关式自适应学习模式保证学习效果

讲师一对一辅导,在线答疑解惑,指导就业!

相关推荐 更多

大数据是什么?与数据之间有什么区别?

大数据是什么?从字面的理解我可以认为他是大量的数据,而在计算机网络领域则将大数据定义为需要更新处理模式才能具有更强的决策力,洞察发现力和流程优化能力来适应海量,高增长了和多样化的薪资资产。因此大数据不仅仅是在数据量的变化,好包括其增长速度以及多样化的特性。

15584

2019-06-06 15:48:59

大数据应用技术的发展方向分析

如今,大数据的应用对企业公司以及个人都产生了深远影响,本文就来预测一下大数据应用技术的发展方向。可以预见的是,数据资产管理、数据资产管理、AI驱动的数据基础设施、面向AI的分布式计算框架和数据安全这些都将成为大数据应用技术的发展方向。对大数据应用技术感兴趣的小伙伴,可以接着往下看小编的的详细分析。

8154

2019-10-29 17:24:18

Kylin开发教程 从原理讲解到实践演练

众所周知,Kylin是一个可扩展的超快OLAP引擎,它能够提供Hadoop ANSI SQL借口和交互式查询,还可以和BI工具无缝整合,为百亿用户构建立方体。既然学习Kylin这么有必要,那么我们该如何学习它呢?这里为大家介绍博学谷的Kylin开发教程,本教程将会对Kylin进行系统化梳理,包括了Kylin的技术架构、运维不熟、增量构建、实时构建、性能优化等内容,带领大家从原理讲解到实战演练。

6909

2019-11-25 12:22:09

大数据Apache Hadoop YARN 工作原理介绍

Apache Hadoop YARN是一种新的 Hadoop 资源管理器,通用资源管理系统可为上层应用提供统一的资源管理和调度,引入为集群在利用率、资源统一管理和数据共享等方面具有很强的优势。

7184

2020-04-27 14:27:28

大数据行业现在工作好不好找?很难吗?

大数据需求越来越多,国家也在开设相关岗位,从2018年开始就逐年较大的增长。报考大学的学生和家长也对大数据,人工智能非常感兴趣,大数据连续3年进了前5,而且学历主要是本科就可以。可以预见的将来这几年,这真的是一个朝阳行业,而且现在缺口很大。

7631

2022-07-01 18:15:56