在线客服

扫描二维码

下载博学谷APP

扫描二维码

关注博学谷微信公众号

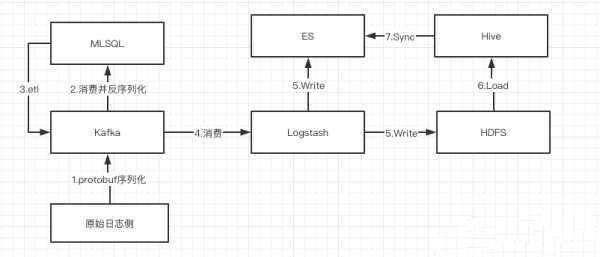

Logstash开发采集上亿级别数据,需求属于日志采集的范畴,Logstash本身不支持反序列化功能,需要自定义开发ruby插件来支持,使用MLSQL结合UDF的方式进行流式处理。MLSQL写入hdfs会产生大量的小文件,需要单独开发合并文件的功能,写入es的数据是需要数仓结合其他业务数据进行建模,用离线处理的方式。

开发背景:公司业务系统做优化改造,同时为了能够实现全链路监控需收集所有业务系统之间的调用日志;数据情况:每天20亿以上;机器成本:3台kafka集群;2台logstash采集机器;技术:Java,MQ,MLSQL,Logstash。

采集流程:

MLSQL 消费MQ:原始日志产生侧通过protobuf进行序列化推送至mq,然后通过MLSQL进行反序列化并进行简单的etl处理后,再推送至MQ;

通过Logstash进行消费MQ:通过logstash消费经过MLSQL处理后的数据,并在这里通过ruby进行再次的加工处理,最后写入es和hdfs(一部分流程推送到es是业务侧使用,而另一部分写入hdfs是提供给数仓使用)

数仓建模:通过数仓建模,将最后的指标结果推送至es提供给业务侧使用,主要是借鉴这个需求讲解Logstash在实际场景中的使用以及优化。

Logstash开发流程:

1、确定日志格式

一个日志文件里肯定是不止一种日志格式,也有可能是标准化的格式,这里需要跟日志产生侧进行确认格式。

2、调试grok

确定好日志格式后,编写grok语法,然后进行调试,本人是通过kibana6自带的grok debug进行调试。结合该需求背景,最后经过logstash采集的时候,其实已经通过MLSQL进行了处理,最后Logstash消费的是格式就是一个json字符串,所以不需要grok语法。

3、调试ruby

结合该需求,使用ruby进行一些清洗逻辑

4、优化

优化工作在整个需求开发周期的比例较大,数据量较大资源较少,具体优化思路如下:

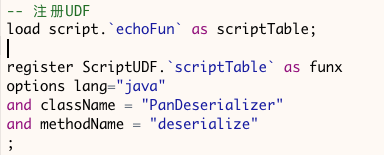

(1)MLSQL优化

这部分的优化工作主要是在反序化这块,剔除一部分无用字段,以及提前过滤一部分数据量,一部分注册UDF的代码:

(2)Kafka端优化

因kafka集群是集团共用,所以kafka端的优化其实只涉及到消费端的优化。这里只调节数据压缩、消费者线程数这两个参数。

(3)hdfs优化

logstash写入hdfs的部分不用使用自带的webhdfs插件,而是自定义的插件。

因自定义插件中涉及到文件锁的问题,会通过比对前后两次文件是否一致来进行文件最后的刷写,所以这里只能通过减少文件的更新频率来减少上下文的切换以及刷写操作

(4)ES优化

es部分的优化也只是涉及到写优化,比如批量写入、调大线程数、增加refresh间隔、禁止swapping交换内存、禁止refresh和replica操作,调大index buffer等操作。

— 申请免费试学名额 —

在职想转行提升,担心学不会?根据个人情况规划学习路线,闯关式自适应学习模式保证学习效果

讲师一对一辅导,在线答疑解惑,指导就业!

相关推荐 更多

Java开发的就业方向有哪些?Java程序员市场已经饱和了吗?

Java开发的就业方向有哪些?Java程序员市场已经饱和了吗?Java开发应用比较广泛,很多公司需要java方面的程序员,随着用户体验需求要求越来越高,对于高级程序员的需求还是很大的,想要进入Java开发行业要制定好自己的职业规划。Java行业本身人才需求是供不应求。

12812

2019-08-08 09:43:59

Java认证考试是什么?Java考试内容有什么?

Java认证考试是什么?Java考试内容有什么?Java认证考试是由Sun公司组织,设置Java 相关的Java程序员和Java开发员认证,考试合格后颁发的国际通用的Java程序员证书。

13490

2019-08-06 17:19:04

MySQL数据库优化可以从哪些方面入手?具体怎么做?

MySQL数据库优化可以从哪些方面入手?具体怎么做?一般我们主要从优化SQL语句、优化数据库结构、优化Mysql服务器等几方面入手,而优化SQL语句又可以分为优化查询语句和其他执行语句;数据库结构也可以从字段类型、字符编码、适当拆分、增加冗余和数据库表来做优化;至于优化Mysql服务器就更简单了,需要遵循一定的优化原则即可。现在我们来看看具体的优化方案吧!

6714

2019-10-24 15:26:42

Java并发与线程免费课程推荐

Java并发与线程免费课程推荐,Java开发中涉及线程的基础知识、线程的启动与终止、线程间的互斥处理与协作、线程的应用、线程的数量管理以及性能优化等内容。

5585

2019-12-03 15:07:22

博学谷Java架构师课程主要讲解哪些内容?

Java架构师课程内容主讲:互联网微服务前沿技术栈、大型互联网分布式架构、全景消息通信实战、架构师源码深度剖析、海量数据处理、服务实战演练篇、大型项目性能优化、软件架构设计攻略、架构师武器库、手撕面试官、黑马顺风车实战项目、面向面试的算法实战、通用解决方案、人工智能、数据挖掘等内容。接下来我们具体来看下。

6740

2022-09-29 18:43:00