在线客服

扫描二维码

下载博学谷APP

扫描二维码

关注博学谷微信公众号

python为什么叫爬虫?为什么python开发会突然火起来?python的脚本特性,python易于配置,对字符的处理也非常灵活,加上python有丰富的网络抓取模块,所以两者经常联系在一起。Python抓取网页文档的接口更简洁;相比于其他动态脚本语言,Python的urllib2包提供了较为完整的访问网页文档的API。

作为一门编程语言而言,Python是纯粹的自由软件,以简洁清晰的语法和强制使用空白符进行语句缩进的特点从而深受程序员的喜爱。使用python来完成编程任务的话编写的代码量更少,代码简洁简短可读性更强,一个团队进行开发的时候读别人的代码会更快,开发效率会更高,使工作变得更加高效。

这是一门非常适合开发网络爬虫的编程语言,而且相比于其他静态编程语言,Python抓取网页文档的接口更简洁;相比于其他动态脚本语言,Python的urllib2包提供了较为完整的访问网页文档的API。此外,python中有优秀的第三方包可以高效实现网页抓取,并可用极短的代码完成网页的标签过滤功能。

一、你知道python爬虫是什么吗?

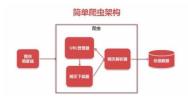

在进入文章之前,我们首先需要知道什么是爬虫。爬虫,即网络爬虫,大家可以理解为在网络上爬行的一只蜘蛛,互联网就比作一张大网,而爬虫便是在这张网上爬来爬去的蜘蛛,如果它遇到自己的猎物(所需要的资源),那么它就会将其抓取下来。比如它在抓取一个网页,在这个网中他发现了一条道路,其实就是指向网页的超链接,那么它就可以爬到另一张网上来获取数据。

因为python的脚本特性,python易于配置,对字符的处理也非常灵活,加上python有丰富的网络抓取模块,所以两者经常联系在一起。Python爬虫开发工程师,从网站某一个页面(通常是首页)开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一直循环下去,直到把这个网站所有的网页都抓取完为止。如果把整个互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。

爬虫可以抓取某个网站或者某个应用的内容,提取有用的价值。也可以模拟用户在浏览器或者App应用上的操作,实现自动化的程序。

爬虫一般是指网络资源的抓取,而因为python的脚本特性,以及其不仅易于配置,而且对字符的处理也非常灵活,加上python有丰富的网络抓取模块,所以两者经常联系在一起。这也就是为什么python被叫做爬虫的原因。

二、用python语言写爬虫的优势有哪些?

1、抓取网页本身的接口

相比与其他静态编程语言,如java,c#,C++,python抓取网页文档的接口更简洁;相比其他动态脚本语言,如perl,shell,python的urllib2包提供了较为完整的访问网页文档的API。

此外,抓取网页有时候需要模拟浏览器的行为,很多网站对于生硬的爬虫抓取都是封杀的。这是我们需要模拟user agent的行为构造合适的请求,譬如模拟用户登陆、模拟session/cookie的存储和设置。在python里都有非常优秀的第三方包帮你搞定,如Requests,mechanize

2、网页抓取后的处理

抓取的网页通常需要处理,比如过滤html标签,提取文本等。python的beautifulsoap提供了简洁的文档处理功能,能用极短的代码完成大部分文档的处理。其实以上功能很多语言和工具都能做,但是用python能够干得最快,最干净。

免责条款:文章部分内容来源于互联网,仅供参考阅读。

— 申请免费试学名额 —

在职想转行提升,担心学不会?根据个人情况规划学习路线,闯关式自适应学习模式保证学习效果

讲师一对一辅导,在线答疑解惑,指导就业!

相关推荐 更多

爬虫高端培训就业课程 python开发学习路线

爬虫高端培训就业课程 python开发学习路线分为八个阶段名主要学习爬虫基础、Python语法教学体验、课程项目体验——python高级语法、课程项目体验 -- numpy、matplotlib、Dajango

8626

2019-06-19 16:11:02

Python爬虫框架有哪些?

在大数据时代,掌握数据就掌握了企业发展的方向。爬虫作为抓取互联网数据的一个途径,成为企业需求量非常大的岗位之一。一般情况下小型的爬虫需求直接使用request库+BS4就可以解决了。稍微复杂一点的可以使用selenium解决JS的异步加载问题。而如果遇到大型的爬虫需求,则需要考虑使用框架了。下面我们来一起学习以及各框架。

9624

2019-07-15 17:57:58

十款Python爬虫框架大推荐

Python爬虫框架的优点真是说也说不完,它可以让程序员以更少的代码实现自定义功能,还可以将更多的精力集中在业务逻辑上,更加的轻松便利。因此本文将为大家推荐十款常见且好用的爬虫框架。

14477

2019-07-30 15:03:49

利用Python数据分析可以做什么?

随着大数据时代的来临和Python编程语言的火爆,Python数据分析早已成为现在职场人的必备核心技能。那么利用Python数据分析可以做什么呢?简单来说,可以做到的内容有很多,比如检查数据表、数据表清洗、数据预处理、数据提取和数据筛选汇总等等。下面小编来为大家详细讲解一下这些用处。

7716

2019-12-20 21:47:50

如何修改goods表结构?怎么操作?

如何修改goods表结构?怎么操作?修改表结构可以使用: alter table语句,多个修改字段之间使用逗号分隔,使数据库中表的字段名称标准化便于查找。

5886

2022-01-25 10:21:06